共计 3938 个字符,预计需要花费 10 分钟才能阅读完成。

说明:

- vidi 论文中包含了 vidi-7B、vidi1.5-9B 模型

- vidi2 论文在 2025.11.24 提交

- vidi2.5 论文是对 vidi2 论文的修订,于 2026.1.20 提交,包含 vidi2、vidi2.5、vidi2.5-think、vidi-edit 模型

- 截至 2026.1.29,vidi-7B、vidi1.5-9B 已开源,其余暂未开源

- basemodel 列表如下:

| vidi 模型 | basemodel |

|---|---|

| vidi-7B | mistralai/Mistral-7B-Instruct-v0.3 |

| vidi1.5-9B | google/gemma-2-9b-it |

1. vidi

关注于 长视频分析 和时间检索

1.1 vidi 怎么做到长视频分析

1.1.1 为什么说其他的视觉大模型没有做到长视频分析

其实其他的视觉大模型也能传入长视频,只不过由于计算资源和模型性能的限制,以固定抽帧数量的方式进行处理,比如某个模型服务最多只能处理 500 帧,默认取帧方式是 1 帧 /s,那么取帧示例如下:

| 50s 视频 | 500s 视频 | 1000s 视频 | 1h 视频 |

|---|---|---|---|

| 50 帧 | 500 帧 | 500 帧 | 500 帧 |

由此可见,其他现有的视觉大模型似乎也可以做到长视频分析

但问题在于 时间检索

- 以 1h 视频为例,只抽 500 帧,相当于每 7.2s 抽一帧,对于每一帧来说,可能前后各有 7.2s 的空白,这段时间里视频能发生的变化可能有很多,所以这必然导致时间检索不可能准确

- 从训练的角度来看,上述抽帧方式根本无法对时间检索做训练(vidi 固定了 1s/ 帧做训练和推理)

1.1.2 vidi 怎么解决其他大模型上出现的问题

(为什么长视频算不过来,为什么推理效果差)

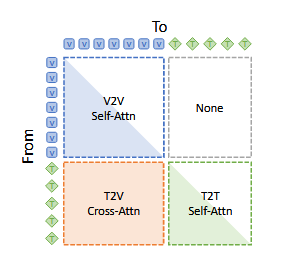

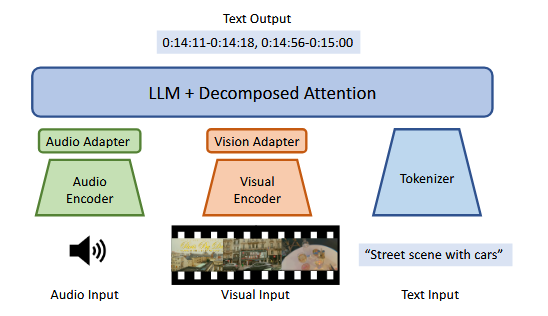

其他的视觉大模型:“大型视觉语言模型 (LVLMs) 传统上通过将视觉 和文本标记拼接成大型语言模型 (LLMs) 的单一同质化输入来整合它们, 从而最大限度地保留预训练的语言能力。”

[V1 V2 V3 V4 V5] [T1 T2 T3]1.1.2.1 S-Attn

Self-Attention 的核心思路就是让序列中的每个元素都能直接 " 看到 " 其他所有元素。S-Attn 这么做的原因是为了解决 RNN 的问题:

(1)长距离依赖问题,导致句子开头的信息传到结尾时已经衰减,也是实际使用中最严重的问题。

(2)无法并行计算,RNN 的工作原理是每当遇到一个新的输入时,首先会将这个输入与上一时刻的记忆状态结合起来。这样导致必须逐个处理 token,前一个处理完才能处理下一个。

(3)训练效率低下,由于无法并行计算,也就导致无法利用现代 GPU 的并行计算能力,单卡训练显然跟不上训练数据和模型参数的暴增。现在都是万卡集群起步,都在疯狂扩建数据中心。

关于长距离依赖问题,举个例子:

"The animal didn't cross the street because it was too tired."

RNN 工作流程需要逐字处理,当处理到 "it" 时,"animal" 的信息可能已经衰减了。

S-Attn

(1)计算 Q 与 K 的点积:对于句子中的每个 token,将其 Q 向量与句子中所有 token 的 K 向量进行点积运算,以计算它们之间的相似度。

(2)缩放点积注意力:为了防止点积结果过大导致的梯度消失问题,我们将点积结果除以 K 向量的维度开方。

(3)应用 Softmax 函数:将缩放后的相似度分数通过 Softmax 函数进行归一化处理,使得所有分数的和为 1,从而得到每个 token 对当前 token 的注意力权重。

(4)加权求和 V 向量:最后,使用得到的注意力权重对 V 向量进行加权求和,以得到当前 token 的自注意力输出。

Query(查询)、Key(键)、Value(值)。计算 Query 和 Key 的相似度,返回相关 Value。

S-Attn+X-Attn

Cross-Attention 的 Q 来自一个序列,K、V 来自另一序列

S-Attn 带来的问题

- 计算复杂度为 O(n2)

- For example, if each frame consists of 400 tokens, a one-hour video would have 1.44M tokens.

1.1.2.2 位置编码

Self-Attention 本身是位置无关的!" 猫在垫子上 " 和 " 在垫子猫上 " 的注意力计算结果相同。

又比如,“张三 喜欢 吃 苹果,李四 喜欢 吃 香蕉”,token 之间本来有的位置关系不应该被丢失。

所以 LLM 中引入位置编码。

多种位置编码如下:

| 位置编码 | 如何影响注意力得分 | 主要偏置 |

|---|---|---|

| APE | 改 Q/K 本身 | 绝对位置 |

| Sinusoidal | 隐式相对距离 | 距离连续性 |

| RPE | 直接加分数项 | 相对结构 |

| RoPE | 旋转内积空间 | 相对位移不变性 |

这在文本 token 中是十分有意义的,但是对于如下的情况:

[V1 V2 V3 V4 V5] [T1 T2 T3]V5 与 T1 的联系 显然要比 V5 与 T2 的联系要紧密,由于人为的 token 拼接,使得原本不一定有联系的 token 被拼接到了一起,使得文本 token 更关注视频 token 的末尾。

导致的问题:对长视频的理解“不均匀”,时间检索也不准确

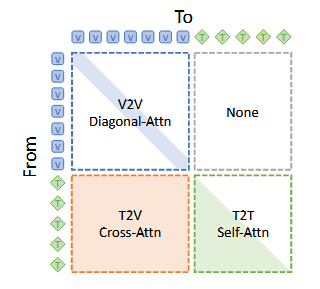

1.1.2.3 D-Attn

去除 T2V 的偏置位置编码

文本 token 位置与视觉 token 位置是没有联系的,如果依然使用传统 LLM 的位置编码,那么会产生不良影响,所以需要去除

V2V 对角化

使每个视觉 token 仅关注自身

这样计算复杂度可从 O(|V |2) 降低到 O(|V |)

“在我们的实验中, 我们证明了该方法在实现与全注意力相似性能的同时, 还能节省大量计算资源”

1.1.3 小结

vidi 使用 D -Attn 的架构使得视觉大模型有潜力应对长视频的输入

1.2 时间检索

1.2.1 多模态对齐

此阶段专注于将视觉和音频数据与相应的文本描述和时间戳进行对齐。

- 首先使用视觉和音频字幕数据训练视觉和音频适配器, 同时冻结模型的其余部分。

- 然后, 在带有真实时间范围的合成视频 / 音频数据上联合训练大语言模型和适配器, 使模型能够学习多模态到时间的接地。(用剪好的带时间标注的视频 / 音频数据训练)

- 使用真实视频对模型进行微调, 通过配对 (即时间戳和字幕 /ASR) 数据的监督来缩小合成和真实场景内容之间的领域差距。(用带对应文字的时间戳数据进行训练)

1.2.2 post train

1.2.2.1 Dense Captions(密集字幕 / 密集标注)

生成结构化字幕以保持文本‐片段的一致性, 并涵盖每个视频片段中的细节。具体而言, 每个字幕包含六个方面:

1) 视频主体,

2) 主体动作,

3) 动作发生的场景环境以及屏幕上的所有视觉文本覆盖, 包括徽标、字幕、标志或其他文字,

4) 视觉风格或特效, 包括视频效果、动画、风格、构图和照明,

5) 相机参数, 包括相机运动、角度和焦距,

6) 用于常识推理的背景知识, 例如著名地标、名人或历史事件。

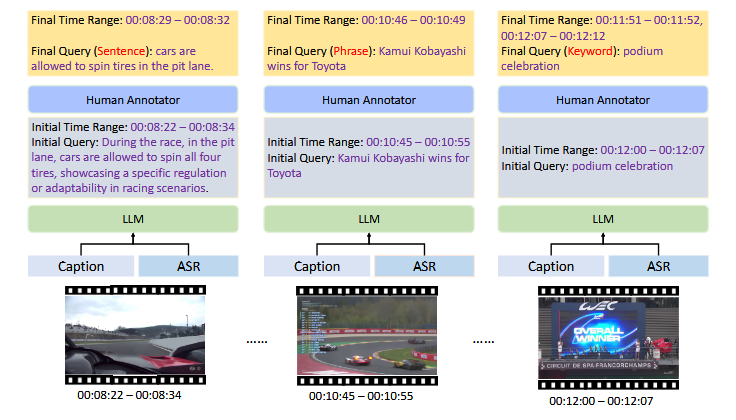

1.2.2.2 查询与时间戳对

首先将所有视频片段的详细密集字幕、字幕以及时间戳相结合, 以提供视频内容的全面文本表示。

在 CoT 提示的指导下, 大语言模型用于生成简 洁摘要, 以捕捉关键事件和主题, 从而理解视频的上下文。通过这种方式,CoT 提示使模型能够进行中间推理, 从而对视频内容产生更准确、连贯的理解。

1.2.2.3 后处理与过滤

- 合并相邻时间范围: 对于每个查询, 我们合并连续时间段或被小间隔(例如,0.5 秒) 分隔的时间段, 前提是该查询出现在字幕中。

- 过滤低置信度查询: 置信度分数低于 0.9 的查询将被丢弃, 以确保可靠性。

- 排除过于宽泛的查询: 与超过 10 个时间戳相关联的查询被视为过于宽泛。我们移除在整个 视频中频繁出现的此类情况。

- 消除机器风格查询: 表现出模板化或不自然表述的查询, 例如“The video concludes...”或“In the closing moments”, 将被过滤掉以确保质量。

之后, 生成的查询和对应的时间范围将被发送给标注员进行最终阶段验证与修改。

1.2.2.4 两轮人工标注

尽管包含筛选过程, 生成的查询和相应的时间范围仍存在表述模糊以及时间戳错位的问题。为了获得高质量的标注, 我们进一步设计了全面的人机协同优化流程。标注员首先检查每个查询的清晰度和 相关性。如果查询存在歧义或不切实际, 则需要对其进行重写, 以准确反映视频内容。之后, 标注员会回顾 整个视频, 以确定与优化后查询对应的精确时间段。此外, 另一位标注员需要独立审查这些标注。此阶段发 现的分歧将通过讨论或咨询资深标注员解决。

2. vidi2.5

以下内容仅包含对 vidi 的技术上的更新

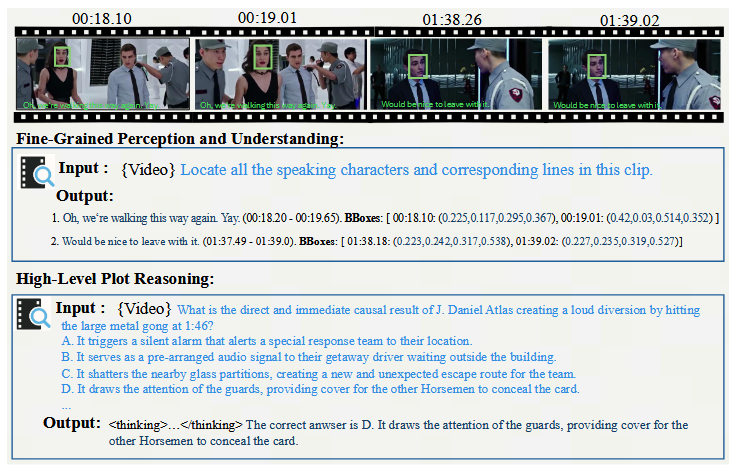

2.1 时空定位 STG

vidi 已有时间定位能力

为了提升空间能力,利用现有的图像级空间定位数据集来合成大规模时空视频定位对, 有效桥接了空间和时间对齐。此外, 还收集了大量真实世界视频时空定位标注, 这显著提升了模型高精度定位时间范围和边界框的能力。

2.2 通用视频问答能力

Vidi2 进一步验证了这种多模态对齐策略对通用视频问答的泛化性。通过在后训练阶段纳入视频问答数据,Vidi2 能够以高精度回答视觉和听觉问题。扩大多模态对齐数据规模能够持续提升整体视频问答性能。

2.3 思考模型

Vidi2.5‐Think 采用基于 VERL 构建的高度定制化强化学习框架进行训练。训练数据包括多样化的多模态指令跟随示例, 涵盖视频感知、音频理解、叙事理解以及专业拍摄与剪辑技巧。这些指令既包括多项选择视觉问答任务, 也包括开放式推理任务。该模型通过结合可验证奖励和充当评判者的大语言模型进行优化, 以评估预测理由、生成响应的质量及其相互一致性。

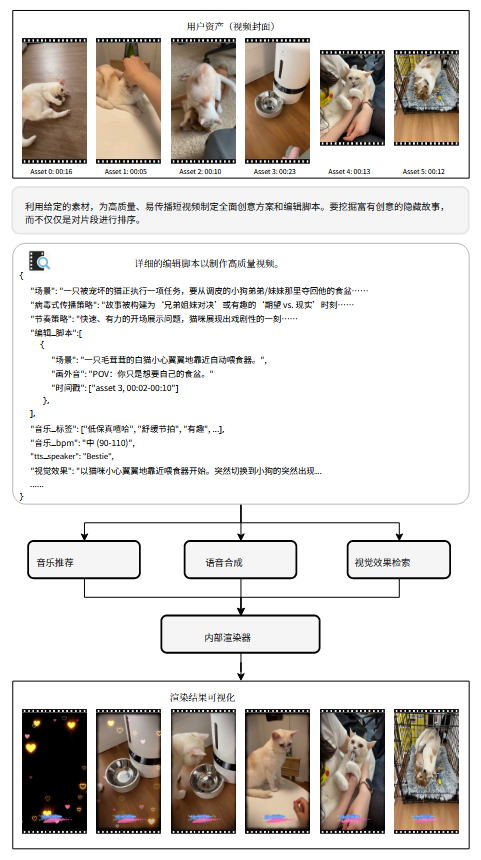

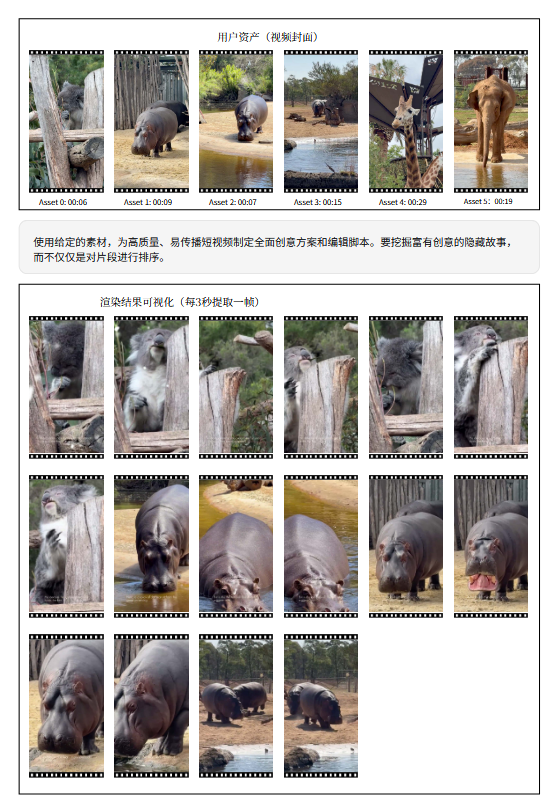

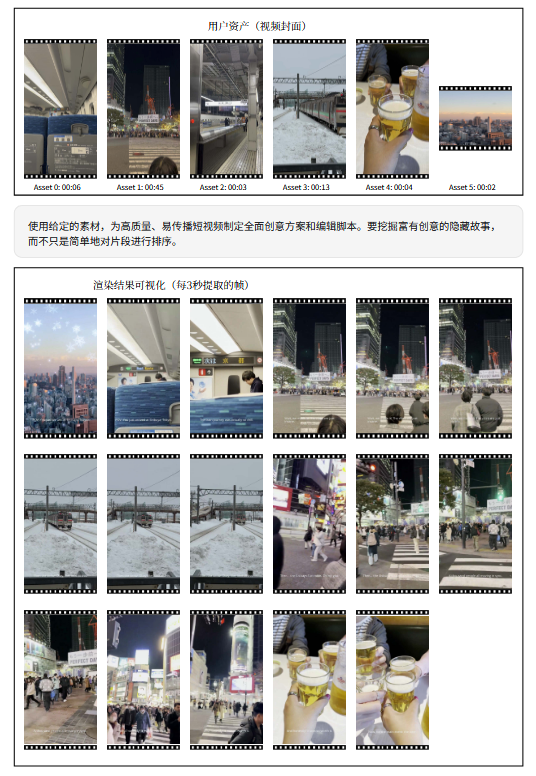

2.4 视频编辑规划(视频脚本)——Vidi‐Edit

(基于 VIDI2.5‐Think)

2.4.1 背景音乐 + 配音 + 视频剪辑

2.4.2 高光排列

2.5 vidi2.5 总结

- 实现了前所未有的端到端时空定位性能

- 可作为下一代视频创作和理解场景的基础模型

- VIDI2.5‐Think——复杂推理场景

- Vidi‐Edit 能够从原始视频素材生成结构化编辑计划, 其中明确了叙事结构、音频属性和视觉编辑意图。

- 提出了评估基准